Дилемма смещения–дисперсии в статистике и в машинном обучении — это свойство набора моделей предсказания, по которому модели с меньшим смещением в параметре оценки имеют более высокую дисперсию оценки параметра в выборках и наоборот. Дилемма или проблема смещения–дисперсии является конфликтом в попытке одновременно минимизировать эти два источника ошибки[en], которые мешают алгоритмам обучения с учителем делать обобщение за пределами тренировочного набора[en].

- Смещение — это ошибка, возникающая в результате ошибочного предположения в алгоритме обучения. В результате большого смещения алгоритм может пропустить связь между признаками и выводом (недообучение).

- Дисперсия — это ошибка чувствительности к малым отклонениям в тренировочном наборе. При высокой дисперсии алгоритм может как-то трактовать случайный шум[en] в тренировочном наборе, а не желаемый результат (переобучение).

Разложение смещения–дисперсии — это способ анализа ожидаемой ошибки обобщения[en] алгоритма обучения для частной задачи сведением к сумме трёх членов — смещения, дисперсии и величины, называемой неустранимой погрешностью, которая является результатом шума в самой задаче.

Дилемма возникает во всех формах [Обучение с учителем|обучения с учителем]] — в классификации, регрессии (аппроксимация функции)[1][2] и структурном обучении[en]. Дилемма также вовлекается для объяснения эффективности эвристики при обучении людей[3].

Побудительные причины

Дилемма смещения–дисперсии является центральной проблемой в обучении с учителем. В идеале, хотят выбрать модель, которая точно схватывает закономерности в тренировочных данных и способна обобщить хорошо на неизвестные данные. К сожалению, обычно это невозможно сделать одновременно. Методы обучения с высокой дисперсией могут хорошо представлять тренировочный набор, но имеют риск быть переобученными для данных с шумом или непрезентативных данных. В отличие от них, алгоритмы с низкой дисперсией обычно дают более простые модели, не склонно к переобучению, но может оказаться недообученным, что приводит к пропуску важных свойств.

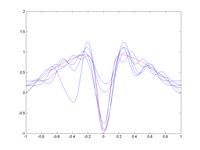

Модели с малым смещением обычно более сложны (например, в них регрессионные многочлены имеют более высокий порядок), что позволяет им представлять тренировочное множество более точно. Однако они могут иметь большую компоненту шума[en] тренировочного набора, что делает предсказание менее точным вопреки добавленной сложности. Для контраста, модели с высоким смещением относительно более просты (имеют многочлены меньшего порядка или даже линейные), но могут давать низкую дисперсию предсказаний, если применяются вне тренировочного набора.

Разложение смещения–дисперсии квадратичной ошибки

Предположим, что у нас есть тренировочное множество, состоящее из набора точек и вещественных значений , связанных с каждой из этих точек . Мы предполагаем, что есть функция с шумом , где шум имеет нулевое среднее и дисперсию .

Мы хотим найти функцию , которая аппроксимирует истинную функцию настолько хорошо, насколько возможно, в смысле некоторого алгоритма обучения. Мы делаем понятие «настолько хорошо, насколько возможно» точным путём измерения среденквадратичной ошибки[en] между и — мы хотим, чтобы значение было минимальным как для точек , так и за пределами нашей выборки. Естественно, мы не можем сделать это идеально, поскольку содержит шум . Это означает, что мы должны быть готовы принять неустранимую ошибку в любой функции, с которой будем работать.

Поиск функции , которая обобщается для точек вне тренировочного набора, может быть осуществлён любым из несчётного числа алгоритмов, используемых для обучения с учителем. Оказывается, что какую бы функцию мы ни выбрали, мы можем разложить её ожидаемую ошибку на непросмотренном экземпляре данных следующим образом:[4][5].

- ,

где

и

Математические ожидания пробегают разные варианты выбора тренировочного набора из одного и того же совместного распределения . Три члена представляют

- квадрат смещения метода обучения, который можно рассматривать как ошибку, вызванную упрощением предположений, принятых в методе. Например, когда применяется аппроксимация нелинейной функции при использовании метода обучения для линейных моделей[en], будет появляться ошибка в оценке как результат такого допущения;

- дисперсия метода обучения, или, интуитивно, как далеко метод обучения уведёт от среднего значения;

- неустранимая ошибка . Поскольку все три величины неотрицательны, они формируют нижнюю границу ожидаемой ошибки на непросмотренных данных[4].

Чем более сложна модель , тем больше точек данных она захватывает и тем меньше будет смещение. Однако сложность приводит модель к захвату большего числа точек, а потому её дисперсия будет больше.

Вывод

Вывод разложения смещения–дисперсии для среднеквадратичной ошибки приведён ниже[6][7]. Для удобства введём обозначения и . Во-первых, вспомним, что по определению для любой случайной переменной мы имеем

Переставив члены получим:

Поскольку детерминирована,

- .

Тогда из и вытекает, что .

Но поскольку , получаем

Так как и независимы, мы можем записать

Приложение к регрессии

Разложение смещения–дисперсии образует концептуальный базис для методов регуляризации регрессии, таких как Lasso[en] и гребневая регрессия. Методы регуляризации вводят смещение в решение регрессии, которая уменьшает дисперсию значительно ближе к решению обычный метод наименьших квадратов[en] (ОМНК, англ. Ordinary Least Squares, OLS). Хотя решение ОМНК даёт несмещённую оценку регрессии, решения с меньшей дисперсией, полученные путём регуляризации, обеспечивают превосходную среднеквадратичную ошибку.

Приложение к классификации

Разложение смещение–дисперсия первоначально было сформулировано для линейной регрессии методом наименьших квадратов. Для случая классификации с 0-1 функцией потерь (доля неправильно классифицированных), можно найти похожее разложение[8][9]. Альтернативно, если задача классификации может быть сформулирована как вероятностная классификация[en], ожидание квадрата ошибки предсказанных вероятностей по отношению к истинным вероятностям может быть разложено как и ранее[10].

Подходы

Снижение размерности и отбор признаков могут уменьшить дисперсию путём упрощения моделей. Аналогично, больше тренировочное множество приводит к уменьшению дисперсии. Добавление признаков (предсказателей) ведёт к уменьшению смещения за счёт увеличения дисперсии. Алгоритмы обучения обычно имеют некоторые настраиваемые параметры, которые контролируют смещение и дисперсию. Например,

- (Обобщённые[en]) линейные модели могут быть регуляризованы для уменьшения дисперсии за счёт увеличения смещения [11].

- в искусственных нейронных сетях дисперсия увеличивается и смещение уменьшается с увеличением числа скрытых единиц[1]. Подобно обобщённым линейным моделям[en] для них тоже обычно применяется регуляризация.

- В моделях k-ближайших соседей большое значение k ведёт к большому смещению и низкой дисперсии (см. ниже).

- В обучении на примерах, регуляризация может быть полечена путём смешения прототипов и примеров[12].

- В деревьях решений глубина дерев определяет дисперсию. Деревья решений обычно обрезаются для контроля дисперсии[13].

Один из способов разрешения дилеммы — использование смешенных моделей[en] и композиционного обучения[en][14][15]. Например, форсирование[en] комбинирует несколько «слабых» (с высоким смещением) моделей в сборку, которая имеет более низкое смещение, чем каждая из индивидуальных моделей, в то время как бэггинг комбинирует «строгое» обучение так, что уменьшается дисперсия.

k-ближайших соседей

В случае регрессии k-ближайших соседей существует выражение в замкнутой форме[en], связывающее разложение смещение–дисперсия с параметром k[5]:

где являются k ближайшими соседями x в тренировочном наборе. Смещение (первый член) является монотонно возрастающей функцией от k, в то время как дисперсия (второй член) убывает по мере роста k. Фактически, при «разумных предположениях» оценщика смещения ближайшего соседа (1-NN) полностью обращается в нуль, когда размер тренировочного множества стремится к бесконечности[1].

Приложение к обучению людей

В то время как дилемма смещения-дисперсии широко обсуждается в контексте обучения машин, она была проверена в контексте когнитивных способностей человека, прежде всего Гердом Гигеренцером с соавторами. Они утверждают, что (см. ссылки ниже) человеческий мозг решает дилемму в случае разреженных плохо описанных тренировочных наборов, полученных в результате личного опыта, путём использования эвристики высокого смещения/низкой дисперсия. Это отражает факт, что подход с нулевым смещением имеет плохую обобщаемость к новым ситуациям, а также беспричинно предполагает точное знание состояния мира. Получающаяся эвристика относительно проста, но даёт лучшее соответствие широкому разнообразию ситуаций[3].

Гиман и др.[1] возражают, что из дилеммы смещения-дисперсии следует, что такие возможности, как распознавание общих объектов, не может быть получено с нуля, а требует определённого «жёсткого монтажа», который затем превращается в опыт. Именно поэтому подходы к заключениям без модели требуют неоправданно больших наборов тренировочных наборов, если нужно избежать высокой дисперсии.

См. также

Примечания

- 1 2 3 4 Geman, Bienenstock, Doursat, 1992, с. 1–58.

- ↑ Encyclopedia of Machine Learning, 2011, с. 100-101.

- 1 2 Gigerenzer, Brighton, 2009, с. 107–143.

- 1 2 James, Witten, Hastie, Tibshirani, 2013, с. 34.

- 1 2 Hastie, Tibshirani, Friedman, 2009, с. 223.

- ↑ Vijayakumar, 2007.

- ↑ Shakhnarovich, 2011.

- ↑ Domingos, 2000.

- ↑ Valentini, Dietterich, 2004, с. 725–775.

- ↑ Manning, Raghavan, Schütze, 2008, с. 308–314.

- ↑ Belsley, 1991.

- ↑ Gagliardi, 2011, с. 123–139.

- ↑ James, Witten, Hastie, Tibshirani, 2013, с. 307.

- ↑ Ting, Vijaykumar, Schaal, 2011, с. 615.

- ↑ Fortmann-Roe, 2012.

Литература

- Stuart Geman, Bienenstock E., Doursat R. Neural networks and the bias/variance dilemma // Neural Computation. — 1992. — Т. 4. — DOI:10.1162/neco.1992.4.1.1.

- Bias–variance decomposition // Encyclopedia of Machine Learning. — 2011.

- Gerd Gigerenzer, Henry Brighton. Homo Heuristicus: Why Biased Minds Make Better Inferences. — 2009. — Т. 1. — DOI:10.1111/j.1756-8765.2008.01006.x. — PMID 25164802.

- Gareth James, Daniela Witten, Trevor Hastie, Robert Tibshirani. An Introduction to Statistical Learning. — Springer, 2013.

- Trevor Hastie, Robert Tibshirani, Jerome Friedman. The Elements of Statistical Learning. — 2009.

- Sethu Vijayakumar. The Bias–Variance Tradeoff. — University Edinburgh, 2007.

- Greg Shakhnarovich. Notes on derivation of bias-variance decomposition in linear regression. — 2011. Архивировано 21 августа 2014 года.

- David Belsley. 7Conditioning diagnostics : collinearity and weak data in regression. — New York: Wiley, 1991. — ISBN 978-0471528890.

- Pedro Domingos. A unified bias-variance decomposition // ICML. — 2000.

- Giorgio Valentini, Thomas G. Dietterich. Bias–variance analysis of support vector machines for the development of SVM-based ensemble methods // JMLR. — 2004. — Т. 5.

- Christopher D. Manning, Prabhakar Raghavan, Hinrich Schütze. Introduction to Information Retrieval. — Cambridge University Press, 2008.

- Gagliardi F. Instance-based classifiers applied to medical databases: diagnosis and knowledge extraction // Artificial Intelligence in Medicine. — 2011. — Т. 52, вып. 3. — DOI:10.1016/j.artmed.2011.04.002.

- Jo-Anne Ting, Sethu Vijaykumar, Stefan Schaal. Locally Weighted Regression for Control. In Encyclopedia of Machine Learning / Claude Sammut, Geoffrey I. Webb.. — Springer, 2011. — С. 615.

- Scott Fortmann-Roe. Understanding the Bias–Variance Tradeoff. — 2012.

Для улучшения этой статьи желательно: |

Данная страница на сайте WikiSort.ru содержит текст со страницы сайта "Википедия".

Если Вы хотите её отредактировать, то можете сделать это на странице редактирования в Википедии.

Если сделанные Вами правки не будут кем-нибудь удалены, то через несколько дней они появятся на сайте WikiSort.ru .

![{\displaystyle {\begin{aligned}\operatorname {E} {\Big [}{\big (}y-{\hat {f}}(x){\big )}^{2}{\Big ]}&={\Big (}\operatorname {Bias} {\big [}{\hat {f}}(x){\big ]}{\Big )}^{2}+\operatorname {Var} {\big [}{\hat {f}}(x){\big ]}+\sigma ^{2}\\\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e5e01509ca06e85039e69a64de77561ecb7c50c0)

![{\displaystyle {\begin{aligned}\operatorname {Bias} {\big [}{\hat {f}}(x){\big ]}=\operatorname {E} {\big [}{\hat {f}}(x)-f(x){\big ]}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2b2080ebdc7a908f7cecdfa6540dd45600b24bf3)

![{\displaystyle {\begin{aligned}\operatorname {Var} {\big [}{\hat {f}}(x){\big ]}=\operatorname {E} [{\hat {f}}(x)^{2}]-{\Big (}\operatorname {E} [{\hat {f}}(x)]{\Big )}^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d0b6567c3e17811e91792be7d13b1521d6fc0adc)

![{\displaystyle {\begin{aligned}\operatorname {Var} [X]=\operatorname {E} [X^{2}]-{\Big (}\operatorname {E} [X]{\Big )}^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a20392a635b7e794cf7b41cb0b5f672ab703f67a)

![{\displaystyle {\begin{aligned}\operatorname {E} [X^{2}]=\operatorname {Var} [X]+{\Big (}\operatorname {E} [X]{\Big )}^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/22abfef78265ff9a9e3b17e6abe6e60c4315c1b4)

![{\displaystyle {\begin{aligned}\operatorname {E} [f]=f\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ed369b79b290adee6e67eb6cdc99b1817fec2688)

![{\displaystyle \operatorname {E} [\varepsilon ]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a9494698413723204253e82aaff8b02684a64ed6)

![{\displaystyle \operatorname {E} [y]=\operatorname {E} [f+\varepsilon ]=\operatorname {E} [f]=f}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d8856b2f0e08d358042e0ef00d8a2904060a896d)

![{\displaystyle \operatorname {Var} [\varepsilon ]=\sigma ^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e1d4c278d7174310f125f7f1625b204d6c9ef6b7)

![{\displaystyle {\begin{aligned}\operatorname {Var} [y]=\operatorname {E} [(y-\operatorname {E} [y])^{2}]=\operatorname {E} [(y-f)^{2}]=\operatorname {E} [(f+\varepsilon -f)^{2}]=\operatorname {E} [\varepsilon ^{2}]=\operatorname {Var} [\varepsilon ]+{\Big (}\operatorname {E} [\varepsilon ]{\Big )}^{2}=\sigma ^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2eb714c31dccb482f6742d6efdc0de204a0aef64)

![{\displaystyle {\begin{aligned}\operatorname {E} {\big [}(y-{\hat {f}})^{2}{\big ]}&=\operatorname {E} [y^{2}+{\hat {f}}^{2}-2y{\hat {f}}]\\&=\operatorname {E} [y^{2}]+\operatorname {E} [{\hat {f}}^{2}]-\operatorname {E} [2y{\hat {f}}]\\&=\operatorname {Var} [y]+\operatorname {E} [y]^{2}+\operatorname {Var} [{\hat {f}}]+\operatorname {E} [{\hat {f}}]^{2}-2f\operatorname {E} [{\hat {f}}]\\&=\operatorname {Var} [y]+\operatorname {Var} [{\hat {f}}]+{\Big (}f^{2}-2f\operatorname {E} [{\hat {f}}]+\operatorname {E} [{\hat {f}}]^{2}{\Big )}\\&=\operatorname {Var} [y]+\operatorname {Var} [{\hat {f}}]+(f-\operatorname {E} [{\hat {f}}])^{2}\\&=\sigma ^{2}+\operatorname {Var} [{\hat {f}}]+\operatorname {Bias} [{\hat {f}}]^{2}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/15c0c4163eb77ad9e0d381a9d42d00fc1e97d04e)

![{\displaystyle \operatorname {E} [(y-{\hat {f}}(x))^{2}\mid X=x]=\left(f(x)-{\frac {1}{k}}\sum _{i=1}^{k}f(N_{i}(x))\right)^{2}+{\frac {\sigma ^{2}}{k}}+\sigma ^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/46dd9ffaa7af7d8738d2799f9f91df7c00d2118a)